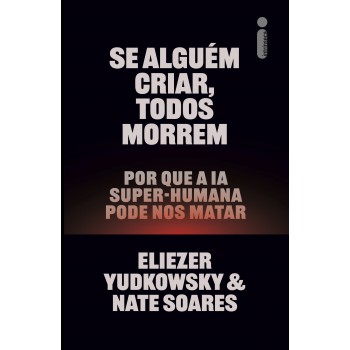

Em 2023, centenas de personalidades influentes no campo da tecnologia assinaram uma carta aberta alertando para o sério risco que as inteligências artificiais representam para a vida humana. Desde então, a corrida da IA só se intensificou, e o mundo está profundamente despreparado para o que está por vir.Por décadas, os autores, dois dos signatários preocupados, têm estudado como as inteligências superiores à humana vão pensar, se comportar e perseguir seus objetivos. A pesquisa deles aponta qu e IAs superinteligentes serão capazes de desenvolver metas próprias que as colocarão em conflito direto com a humanidade e que, nesse cenário, elas sairiam vitoriosas. Não teríamos a menor chance nessa disputa.Como uma máquina superinteligente pode e xtinguir nossa espécie? Por que ela iria querer isso, ou desejar qualquer coisa? Neste livro urgente, Yudkowsky e Soares examinam teorias e evidências, apresentam um possível — e provável — cenário de extinção e o que seria preciso para que a humanid ade sobrevivesse. O mundo está correndo para construir algo realmente novo. E, se alguém criar, todos morrem

| Código: |

9788551015629 |

| EAN: |

9788551015629 |

| Peso (kg): |

0,000 |

| Altura (cm): |

21,00 |

| Largura (cm): |

13,50 |

| Espessura (cm): |

1,90 |

| Especificação |

| Autor |

Eliezer; Soares, Nate |

| Editora |

INTRINSECA |

| Ano Edição |

2026 |

| Número Edição |

1 |